音声で社内ナレッジを引き出すAIアシスタントを作ってみた 〜「話しかけるだけ」でドキュメント検索できる世界へ〜

こんにちは。

今回は、音声で会話しながら、ナレッジベース(社内ドキュメント)から回答してくれるAIアシスタントを試作した話です。

そもそも、なぜ「音声AIアシスタント」?

仕事中って、ドキュメントを探すだけでも地味に時間がかかります。

検索して、ページ開いて、該当箇所を探して…という流れ。

そこで、

「話しかけたら、必要な情報を探して要点だけ返してくれる」

そんな体験ができると便利だよね、という発想から始まりました。

今回作ったもの

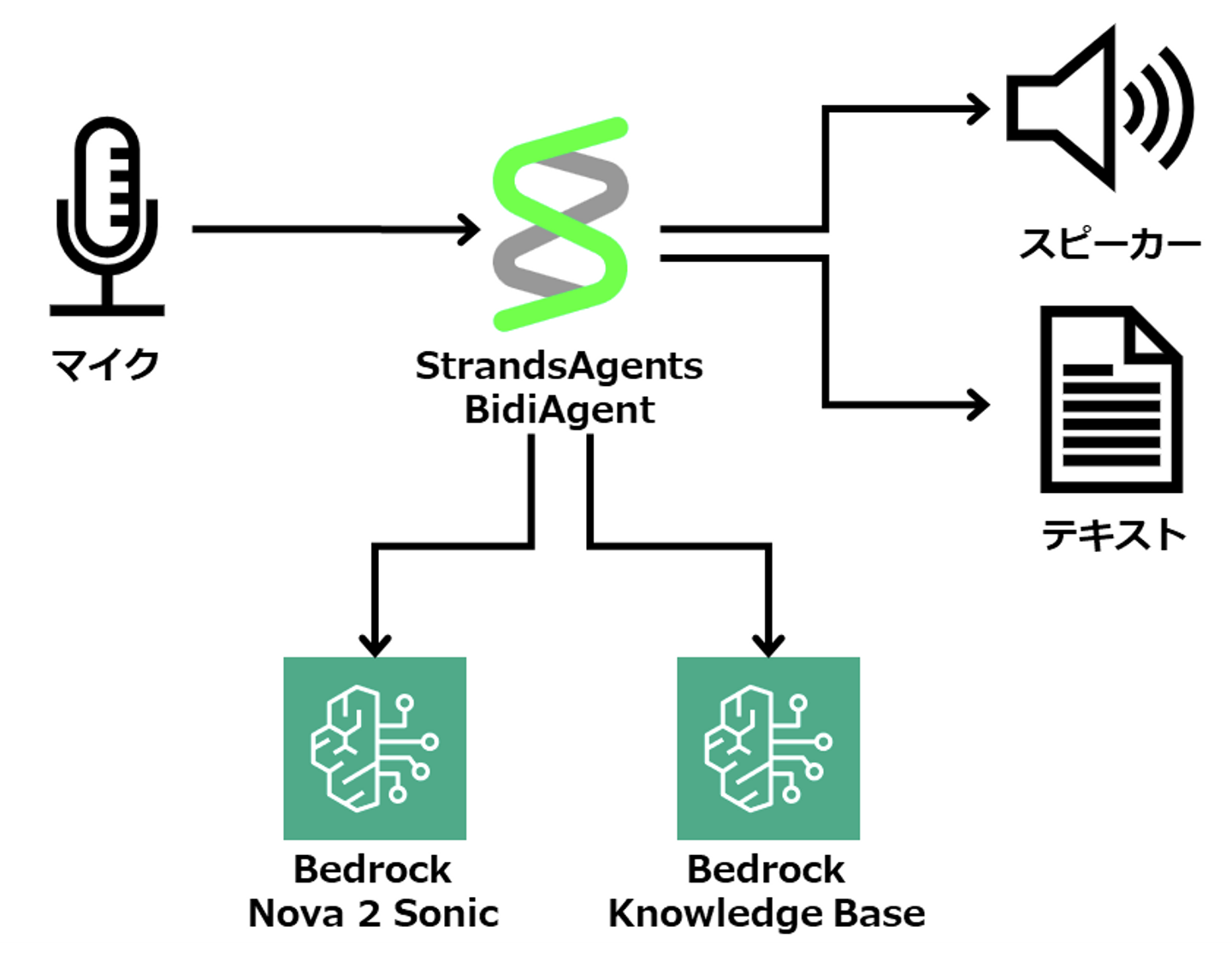

やったことはシンプルです。

- PCのマイクから音声入力

- AIが内容を理解し、必要なら「検索ツール」を呼ぶ

- Bedrock Knowledge Baseから関連情報を取ってくる

- AIが音声で回答(テキスト字幕も表示)

この構成で、AWSサービスのドキュメントを入れたナレッジベースに音声で質問するデモを作りました。

何がうれしい?何がすごい?

1) とにかく“会話として”ストレスが少ない

Nova 2 Sonicは返答が速く、待ち時間が短い。

さらに、アシスタントが話している途中でもこちらが話し始めると、自然に止めて聞き直してくれます。

2) 少ないコードで「音声会話+RAG」までいける

記事内でも「このコード量でリアルタイム音声会話+Knowledge Base検索までいけるのは驚き」と触れられていて、試作のスピード感が高いです。

3) 実務に近い“使い道”が見える

Knowledge Baseと組み合わせることで、実用的なQ&Aができる手応えがありました。

注意点(正直に)

一方で、音声は万能ではなく、

記号・数式・コードの読み上げは苦手な場面もありました(例:1+1の読み上げで演算子が落ちる)。

ここは「音声向きの情報設計」や「読み上げ用の整形」が必要になりそうです。

まとめ

Nova 2 Sonic × StrandsAgents(Bidirectional)× Bedrock Knowledge Baseで、

「話しながら社内ナレッジにアクセスできる」音声アシスタントを作ってみました。

AIは“賢い答えを出す”だけじゃなく、

使う人にとって自然な体験(UX)を作れるかが価値になります。

Acroquestでは、こういう“試して、確かめて、実務につなげる”技術検証も大事にしています。

具体的な実装コードなど詳しくは当社技術ブログに記載しておりますので、詳細を知りたい場合はこちらをご覧ください。

ぜひ、当社で一緒に働いてみませんか?

チャレンジングな案件が多く、成長の機会が多く得られる環境です

当社では、機械学習/AIや生成AIに加えて、AWSやAzureを活用したITサービス開発事業を推進しています。そこで、最先端技術を駆使しながら、社会を進化させたい情熱とスキルのある機械学習・AIエンジニア、クラウドエンジニアを募集しています!

私たちが取り組む案件は、最先端技術を用いる内容や高難易度の内容が多く、チャレンジングな環境なので、成長の機会が多く得られることをお約束します。

/assets/images/23058774/original/664ab399-17f6-4db2-8b84-0ebb01a33c39?1770366937)

/assets/images/10338/original/b4c1f58c-4c92-447a-a0cc-671371e80f3a.png?1392712942)

/assets/images/10338/original/b4c1f58c-4c92-447a-a0cc-671371e80f3a.png?1392712942)